Revista Controle & Instrumentação – Edição nº 254 – 2020 |

||||

| ¤

Cover Page

|

||||

| Computação cognitiva: além do que se vê | ||||

|

||||

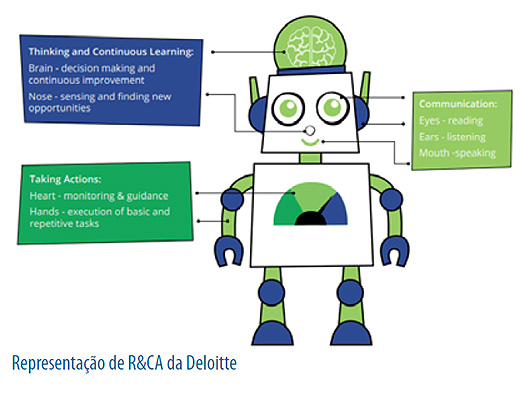

| Existe uma grande distância, entre a velocidade

com que as tecnologias evoluem,

e a habilidade de as empresas

adotarem essas novidades com sucesso, ainda

que a maioria das empresas ao redor do

mundo já assumam que o conhecimento, o

trabalho, e mesmo a vida, estão sendo transformados

pela automação e pela inteligência

artificial e que isso só vai aumentar. Um estudo

da Deloitte (The robots are ready) mostrou

que 53% das empresas já deu start em

projetos de robotização de sua produção, e

o levantamento previa que, para este ano

(2020), esse número chegaria a 72%. Dentro

dessa robotização de processos, a Deloitte

ressaltava as tendências para RPA Robotic

Process Automation e R&CA Robotic & Cognitive Automation, e a urgência em segui-las, pois,

considerava a indústria no ponto de inflexão que determinaria

os rumos e o sucesso dos negócios. Tanto

que considera que, num futuro próximo, não será

possível competir sem algum nível de investimento

em R&CA. Nesta oportunidade, vamos falar um pouco

mais sobre a parte ótica do R&CA, já que ela está trabalhando

há décadas na indústria, e vem se aproximando

do dia-a-dia de todos os sistemas de visão.

|

||||

|

||||

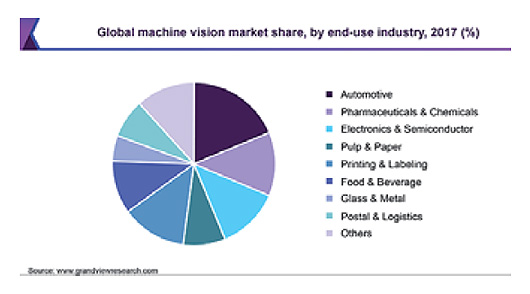

| Um sistema de visão de máquina historicamente se refere a um subconjunto de aplicações de fabricação, que usa tecnologias de visão computacional. Desde a década de 1980, conjuntos de câmeras, iluminação, lentes e softwares ajudam os fabricantes a automatizar e otimizar tarefas, baseadas na visão humana – e não é pouca coisa: o mercado global de visão de máquina atingiu um valor de US$ 9,9 bilhões, em 2019, devendo atingir US$ 15,7 bilhões, em 2025 – considerando aqui visão de máquina como sistemas de visão/ótico ou visão industrial, qualquer tecnologia usada para observar todos os tipos de processos, através da coordenação precisa de softwares e hardwares. | ||||

|

||||

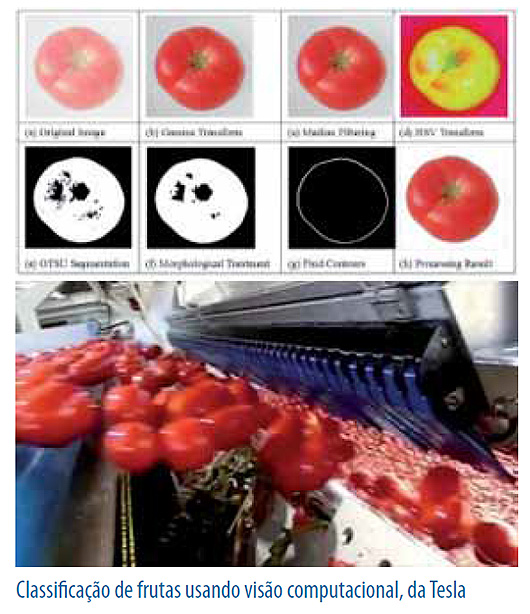

| O crescimento é melhor compreendido quando se pensa nas aplicações dos sistemas de visão: olhando para a área de alimentos e bebidas, esses sistemas são aplicados na agricultura para monitorar o crescimento e a colheita ; no controle de qualidade de alimentos processados como na distribuição de coberturas de pizza ou cor de produtos assados ; no controle de remoção de contaminantes, na classificação de batatas, frutas e carnes ; no controle em tempo real do fatiar ou repartir produtos, como bacon, presunto, queijo e salsichas. A visão hiperespectral pode detectar contaminação alimentos como aves e peixes, enquanto o XRay pode detectar objetos estranhos, e tantas outras aplicações. | ||||

|

||||

| A Tesla fornece, por exemplo, Sistemas de Visão de Máquina turn-key, com capacidade para 7 mil tampas/ horas, destinado à inspeção de tampas que contêm câmeras e controlador de visão, em conjunto com uma automação que posiciona e transporta o produto a tampa onde é detectado se existem rebarbas, ovalização, e ainda, se inspeciona o selo de vedação e o lacre. | ||||

|

||||

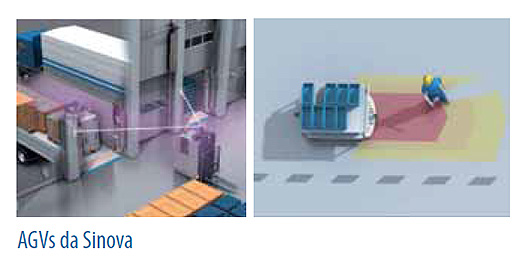

| Uma aplicação que já está se tornando comum é no AGV (Automated Guided Vehicle), um veículo autoguiado com a função de carregar e transportar materiais pelo interior de uma fábrica, depósito ou áreas de carregamento. Guiados por demarcações no chãode-fábrica, e uma avançada tecnologia laser, AGVs são precisos e seguros, podendo mover-se por espaços apertados, e manobrar com habilidade superior às mãos humanas. Eles podem usar o escaneamento para reconhecimento de pessoas e, assim, monitorar a presença de pessoas ou obstáculos, parando o AGV antes de uma colisão; e a um sistema de navegação visual, ou a laser, onde o equipamento faz a leitura do ambiente, orientando o posicionamento do AGV, no layout. Este modelo de navegação é um dos mais seguros, por não precisar de infraestrutura física, somente virtual. Estes sistemas podem ser instalados em qualquer ambiente, e sua infraestrutura utiliza sensores e outros componentes para compor uma arquitetura de automação e de segurança. Por se tratar de elementos visuais, todos precisam de softwares específicos para serem programados e assistidos, durante o funcionamento. Todos estes elementos interagem entre si. Este tipo de interação faz parte de uma inteligência artificial, e é como se os sistemas ópticos fossem os olhos do AGV. | ||||

|

||||

| Um sistema de visão de máquina incorpora tecnologias que permitem a um sistema computacional identificar e inspecionar imagens; permitem extrair dados de imagens digitais que ajudam as empresas a reduzir custos, aprimorar a qualidade e otimizar seus processos gerais. Mas, não se limitam a várias câmeras submetendo o processo a capturas e interpretações. A Cenibra, por exemplo, utiliza vários sistemas, que vão, desde a medição das variáveis nos processos com sensores óticos, passando por transmissão dos dados e segurança em atendimento as Normas Regulamentadoras do Ministério do Trabalho (NR), tanto na planta industrial, quanto no gerenciamento florestal. | ||||

|

||||

| A Klabin, em seus diversos segmentos de negócios,

Florestal, Celulose, Papel e Embalagens, possui

uma ampla gama de produtos, que devem atender

inúmeros requisitos e sistemas ópticos para o controle

da qualidade, e estão entre as tecnologias aplicadas,

desde a floresta, até o controle final de qualidade dos

nossos produtos.

Na unidade de negócio Florestal, a Klabin utiliza o sistema de mapeamento de imagens com sensores passivos, como drones e satélites, e sensor ativo (LiDAR), desde 2017. |

||||

|

||||

| O LiDAR é um sensor baseado na emissão de pulsos

laser, podendo ser embarcado em diferentes plataformas,

como drones, aviões, helicópteros, e até mesmo

em mochilas ou dispositivos manuais. Esta aplicação é

muito importante no inventário florestal, estratificando,

de forma mais detalhada, o crescimento e características

de nossas florestas, melhorando a precisão e assertividade

das estimativas de volume, olhando o todo, e trazendo

as florestas para a tela do computador de maneira digital, em 3D. E, para trabalhar com os dados do LiDAR, são necessários

softwares que leem e interpretam informações

de arquivos nos formatos .las e .laz padrão para

arquivos de nuvens de pontos, resultantes da captura

desse sensor. Hoje, ao classificar visualmente estas imagens por edição, em escritório, sejam de drone ou satélites, são utilizadas ferramentas para vincular as informações de maneira geoespacial, com a base cartográfica onde estas informações são armazenadas em um banco SQL, e integradas com o cadastro florestal, ou seja, conectadas ao sistema ERP. Todas as informações geradas com o LiDAR estão inseridas nos sistemas cartográficos e de planejamento florestal. |

||||

|

||||

| O uso de sistemas de visão para segurança do trabalhador

virou tendência, e ampliou seu espectro: um reconhecimento

facial, para prevenir e reduzir acidentes de

trabalho, está sendo desenvolvido no Centro de Inovação

do SESI de MS, com recursos do Edital de Inovação para

a Indústria, e será implantado na Inflex, que fabrica embalagens

em Dourados/MS. Os medidores FTNIR são utilizados há mais de uma década, e se aplicam às áreas de pesquisa e de qualidade, os medidores e as redes industriais em todo o processo produtivo. O Infravermelho Próximo (NIR) se apresenta como uma poderosa ferramenta para obtenção de dados, por sua vasta aplicação, e por suas principais vantagens: o grande potencial na coleta de dados, e possibilidade de uma análise não destrutiva das amostras (pois, a radiação NIR é suficientemente pequena, o que faz com que a amostra não altere sua estrutura). Se utilizados recursos de transmissão de dados do tipo fibras óticas, por exemplo, tornam as análises a distâncias mais simples e livres de vibração, e descartam a presença de pessoas em ambientes de riscos ou tóxicos. A Transformada de Fourier é uma aliada do NIR, pois, tem como função básica decompor ou separar um sinal de diferentes frequências, com suas respectivas amplitudes. A junção destas duas técnicas forma a tecnologia FTNIR (Fourier Transform Near Infrared), e os espectrômetros com essa tecnologia são usados, há mais de 20 anos, para monitorar processos em diversas indústrias, como a química onde podem ser aplicados, desde a síntese de polímeros, até o monitoramento dos processos de refino. Na indústria alimentícia, espectrômetros FTNIR são capazes de fornecer informações sobre identidade, conformidade e composição química quantitativa do material, nos vários estágios de produção. |

||||

|

||||

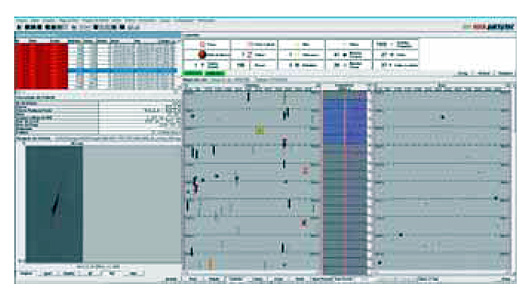

| A unidade de Papel da Klabin lida com diversas normas internacionais, principalmente nas aplicações de papel-cartão, que são utilizadas em embalagens para líquidos, como leite, vinho e sucos, por exemplo, que requerem um controle de qualidade rigoroso. Nas máquinas de Papel cartão, a Klabin vem utilizando sistemas ópticos para controle de qualidade, desde o final dos anos 1990, os WIS (Web Inspection System), compostos por câmeras industriais com alta resolução de 8K (7680 x 4320 pixels), ligadas a um robusto servidor que, através de cálculos analíticos complexos, conseguem, com base nas imagens capturadas, identificar e classificar cada tipo de defeito. A precisão da sua identificação dependerá, mas não se limitará, a fatores como a velocidade da máquina de papel, o número de câmeras instalada, algoritmo utilizado e retroalimentação de informações no sistema. Mas, de nada adianta identificar e classificar os defeitos, se isso não se transformar em uma ação automatizada de correção. Dessa forma, o WIS é conectado ao sistema de controle principal da máquina de papel. Importante também que as informações estejam interligadas às geradas pelos sistemas LIMS (Laboratory Information Management System) e PIMS (Plant Information Management System), possibilitando um gerenciamento eficiente da qualidade do papel. A comunicação utilizada para troca de dados entre os sistemas citados é o OPC-DA. | ||||

|

||||

| Não menos importante que o Papel cartão, os papéis

Kraft e Sack Kraft necessitam de um alto controle de

qualidade em sua produção. Os papéis Kraft são utilizados

nas embalagens de papelão ondulado, que precisam

oferecer resistência às mais diversas condições de armazenamento

e transporte, como ambientes úmidos e com

baixa temperatura, garantindo a integridade da mercadoria,

até o destino final. Os papéis Sack Kraft, empregados

em sacos industriais, precisam atender alguns fatores,

como a resistência, a porosidade, a elasticidade, um ótimo

acabamento e qualidade de impressão. Para atender

essas demandas de qualidade e as normas internacionais,

as máquinas de papel Kraft e papel Sack Kraft possuem

também sistemas ópticos para controle de qualidade, o

sistema WIS, integrados ao sistema de controle principal

da máquina e sistemas auxiliares. De forma semelhante,

o sistema WIS integra o controle final de qualidade do

processo de fabricação de celulose. A Klabin também utiliza sistemas ópticos para controle de qualidade nas cortadeiras, que trabalham com papel cartão, e nas impressoras, que trabalham com papel Sack Kraft para a produção de sacos industriais. Em ambos os casos, um defeito identificado pelo sistema de visão é rapidamente processado e, através de braço mecânico, a chapa de papel é expulsa do fluxo de produção. Vale lembrar que, enquanto a visão humana é ideal para a interpretação qualitativa de uma cena complexa e não estruturada, a visão de máquina se destaca na medição quantitativa de uma cena estruturada, catalisada por sua velocidade, precisão e repetibilidade; também ajudam a prevenir a contaminação humana de salas limpas, e protege os trabalhadores de ambientes que podem ser perigosos. Os olhos humanos respondem aos comprimentos de onda eletromagnéticos de 390 a 770 nanômetros, enquanto as câmeras de vídeo podem detectar comprimentos de onda muito mais amplos do que isso, com alguns sistemas de visão de máquina funcionando nos comprimentos de onda infravermelho, ultravioleta ou raio-X. Como as tecnologias dos sistemas de visão vêm evoluindo, se inserem de maneira natural nas fábricas inteligentes, e na miniaturização de sistemas. Se existe um problema, é que esses sistemas de visão precisam ser utilizados no seu ponto ideal, para garantir um bom funcionamento pós-implementação e, consequentemente, é necessário também ter proficiência nessa execução, uma habilidade que muitos profissionais ainda não possuem. |

||||

|

||||

| A visão de máquina já faz parte da manufatura, principalmente, ao fornecer recursos de inspeção automatizada dos procedimentos de Controle de Qualidade. Mas, o mundo está cada vez mais complexo. Indústria 4.0, Internet das Coisas (IoT), computação em nuvem, inteligência artificial, aprendizado de máquina, e muitas outras tecnologias apresentam desafios na seleção do sistema ideal para cada aplicação. E isso inclui tecnologias de imagem; sensores; visão embutida; deep learning e machine learning; interfaces de robô; transmissão de dados e recursos de processamento de imagem, e outras cada vez mais inusitadas, como, imagens hiperespectrais, que podem fornecer informações sobre a composição química dos materiais que estão sendo fotografados. | ||||

|

||||

| Gustavo ressalta

que a infraestrutura

para utilizar sistemas

de visão varia de

acordo com o porte

da aplicação. Leitores

podem ser utilizados sozinhos para leitura de códigos;

aplicações de inspeção, utilizando a tecnologia de smart

câmeras, envolvem a programação do equipamento, utilizando

um software que acompanha o dispositivo; aplicações

mais complexas podem necessitar, além da câmera,

um computador para o processamento das imagens e,

neste caso, são necessários softwares que analisem e processem

imagens, utilizando a tecnologia de inteligência

artificial. Todas as aplicações contam com sistema de iluminação,

componente fundamental para o sucesso de um

sistema de visão. Também é necessário, na área de controle

de qualidade, o trabalho em conjunto com um sistema

de rejeição, ou seja, ao visualizar um defeito no material

em linha, a câmera, em comunicação com um CLP que

traga embutido um sistema de rejeição, irá identificar a

não conformidade do produto, e enviar um sinal para que

o mesmo seja rejeitado. Então, na maioria das aplicações,

esses sistemas estão interconectados. O sistema de visão é

capaz de efetuar o processamento da imagem e entregar

um resultado, mas, para efetuar a leitura da peça, ela precisa

estar posicionada na linha, e o resultado precisa ser

tratado. Esta integração é feita por uma máquina ou com a

linha do cliente. De qualquer forma, o sistema precisa ser

conectado com diferentes níveis da máquina, para efetuar

a inspeção. O sistema de visão também pode ser conectado

com braços robotizados e outros tipos de robô, que

aumentam a flexibilidade da solução, explica. Alexandre ressalta que, antes de especificar um sistema de visão, é bom consultar se não existem sensores especializados para solução do problema, porque atualmente o mercado de sensores especiais é muito amplo, e pode ser que exista um equipamento com custo melhor para solucionar um problema. Se a decisão for pelo sistema de visão, alguns pontos devem ser considerados antes da implantação, como saber quantas inspeções são necessárias por segundo nessa linha? Com qual rapidez as peças se movimentam na linha? Qual o tamanho da área de inspeção? Qual o nível de precisão será necessário? Será preciso identificar cores? Quais ações se desejam executar com base nos resultados da inspeção? |

||||

|

||||

| Um robô com sistema de visão, por exemplo, pode

realizar múltiplas inspeções por um período muito longo,

de forma mais confiável, eficiente e produtiva que os

métodos tradicionais. A tecnologia de dar olhos aos robôs

é chamada de BinPicking, e é basicamente um sistema

VGR, que permite selecionar e extrair peças empilhadas

aleatoriamente em uma caixa (container), utilizando um

sistema de visão artificial para o reconhecimento e a localização,

bem como um sistema robótico para a extração e

a sua posterior realocação. Os sistemas VGR (Robótica Guiada por Visão) proporcionam um maior grau de liberdade à robótica, dispensando a necessidade de trabalhar em ambientes prédefinidos e indexados. Quando um robô trabalha sem um sistema de visão associado, o meio de trabalho deve ser fixo, o robô deve se movimentar sempre a uma posição pré-determinada, sendo assim, nos vemos obrigados a utilizar sistemas de posicionamento muito precisos, dos objetos a serem manipulados, para que o robô se dirija exatamente onde deve ir. |

||||

|

||||

| O BinPicking já é uma realidade no mercado mundial, e a demanda no Brasil vem crescendo. Segundo Eric, nos próximos dois anos, 68% dos robôs vendidos no mundo, devem trabalhar com um sistema de visão, guiando e corrigindo seus movimentos. | ||||

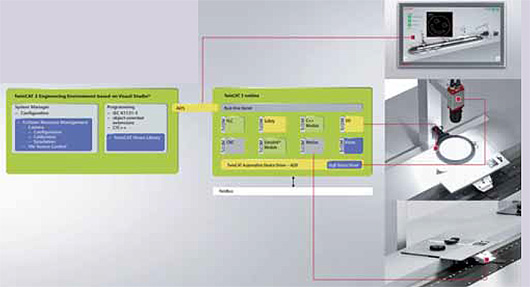

| TwinCAT Vision | ||||

| Como uma tecnologia cada vez mais demandada nos dias atuais, os sistemas de visão se fazem necessários para diversas aplicações, como inspeções de todos os tipos: medição, presença de peças, identificação de defeitos, leitura de QR-Code, sincronia de eixos, entre outras. | ||||

|

||||

| Entretanto, muitas vezes, a implementação de um

sistema de visão esbarra em dificuldades, e o preço pode

ser apontado como

uma das principais,

pois, geralmente, são

sistemas dedicados,

constituídos por componentes

e softwares

caros. Outra dificuldade

é que esses sistemas,

muitas vezes, demandam

treinamento

específico, ou seja,

projetos de visão não

poderiam ser desenvolvidos

pelas mesmas

pessoas que normalmente

desenvolvem a

aplicação da parte de

automação.

Pensando nisso, e no fato de que as aplicações de máquinas demandarão cada vez mais essa tecnologia, a Beckhoff desenvolveu o TwinCAT Vision, um software que permite agregar, de forma bastante simples, os sistemas de visão ao TwinCAT, e programá-lo através das mesmas linguagens em que se programa o TwinCAT PLC, abrindo assim o leque de pessoas que estão aptas a programar esses sistemas, e reduzindo a equipe necessária, além de permitir que os profissionais de automação ganhem mais domínio sobre o que desenvolvem. Do ponto de vista de manutenção, por exemplo, caso ocorra algum problema com o sistema de visão, não é necessário deslocar uma segunda equipe para verificá-lo, tornando assim, toda a solução, mais eficiente e prática. O sistema de visão, utilizando controle baseado em PC, pode apresentar vantagens extremamente competitivas, como uma redução de custo significativa, em relação a outros sistemas dedicados, e com uso das chamadas Smart Cameras, afinal, o custo de uma câmera Gigabit Ethernet é muito inferior ao de uma câmera inteligente, além disso, a redução de custo se dá também devido ao sistema que irá controlar a parte de visão ser o mesmo a fazer a automação da máquina, já que se trata de um hardware baseado em PC de alta capacidade, e extremamente poderoso. O TwinCAT Vision ainda agrega muita tecnologia, permitindo verificar imagens complexas e utilizar com máxima eficácia a capacidade de processamento da CPU, principalmente com processadores de múltiplos núcleos, fazendo com que o tratamento de várias regiões da imagem seja feito em paralelo, por diferentes núcleos do processador. Os sistemas de visão deverão aumentar rapidamente a sua penetração no mercado, alcançando um percentual considerável das máquinas, num futuro próximo, e entrando em processos que hoje não são utilizados. E o TwinCAT Vision, incorporado no controle baseado em PC, tende a ser muito vantajoso para usuários que buscam aliar custo baixo com praticidade, eficiência e poder de processamento. |

||||

|

||||

| LEIA MAIS NA EDIÇÃO IMPRESSA | ||||

| |

||||

| DESEJANDO MAIS INFORMAÇÕES: redacao@editoravalete.com.br | ||||

|

|

|